دیپفیک دشمن خداست! | دیپفیک چیست و چالشهای اخلاقیاش کداماند؟

دیپفیک چیست؟

زن بواگ1: برای شروع، ممکنه کمی درمورد فناوری دیپفیک بگید؟ اینکه اصلاً چی هست و چطوری کار میکنه، چه وقتهایی ازش استفاده میشه و تا الآن چقدر پیشرفت کرده؟

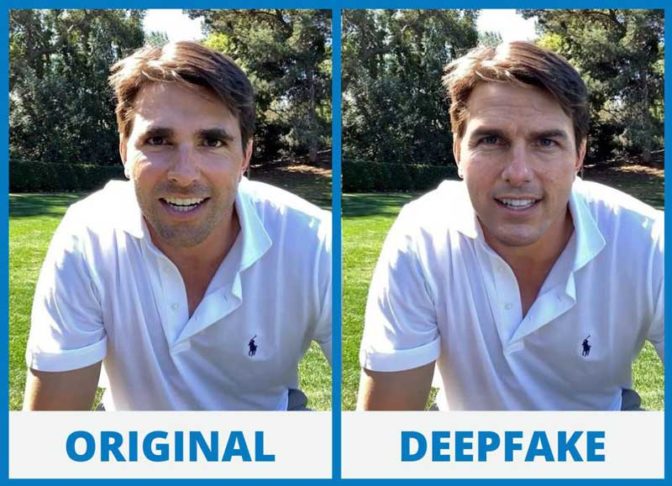

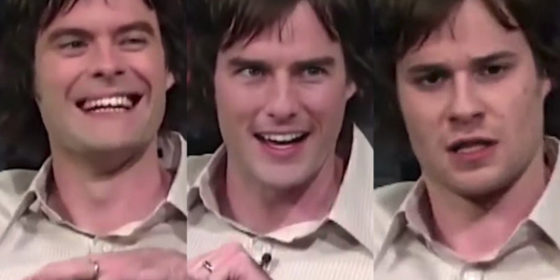

رجینا رینی2: دیپفیک، صدا و/یا ویدئوی ساختگیه که از تکنیکهای یادگیری ماشینی استفاده میکنه تا چهره یا صدای یه کسی رو، روی چهرۀ یه نفر دیگه بذاره. با دیپفیک، میشه فایل صوتی یا تصویری ساخت و نشون داد که یه نفر، کاری رو انجام میده یا چیزی رو میگه که واقعاً هرگز انجام نداده یا نگفته. و این فناوری بسیار پیشرفته است؛ نکتۀ کلیدی اینه که هرچی رایانهتون قدرتمندتر باشه، زمان بیشتری بتونید بذارید، پول بیشتری در اختیار داشته باشید، میتونید دیپفیک بهتری بسازید.

تا حدود پنج یا ده سال پیش، بهجز استودیوهای بزرگ هالیوود با بودجههای سنگینی که برای تولید تصویر کامپیوتری داشتند، هیچکس نمیتونست این کارو انجام بده. اما چیزی که در پنج سال گذشته تغییر کرده، اینه که این فناوری بهحدی پیشرفته شده که مردم میتونند این کارو بهصورت رایگان با تلفن همراه خودشون انجام بدن. قرار نیست کیفیت بسیار بالایی داشته باشه یا مثل جلوههای ویژۀ هالیوودی بشه، اما نسبتاً کیفیت بسیار خوبی خواهد داشت.

باید بدونید که دیپفیک، تغییری اساسی محسوب میشه، فناوریای که تا چندین دهۀ پیش تحتعنوان گرافیک کامپیوتری وجود داشت، الان بهاندازهای ارزون شده که مردم عادی میتونند از اون برای اهداف معمولی استفاده کنند. این فناوری، دیگه فقط در دسترس استودیوهای هالیوود یا آژانسهای اطلاعاتی نیست، بلکه هر کاربر فضای مجازی بهراحتی میتونه بهش دسترسی داشته باشه و باهاش کار کنه.

زن بواگ: شما در مقالۀ خودتون بهمعرفی دیپفیک پرداختید. چی باعث شد که روی همۀ اینها تحقیق کنید؟ آیا خودتون کسی رو میشناسید که تحتتأثیر این فناوری قرار گرفته باشه؟ یا انگیزۀ این کار، سیاسی بوده؟ آیا وقتی صفحات رو در فضای مجازی بالاپایین میکردید، در جایی به دیپفیک برخوردید و با خودتون گفتید این همون چیزیه که در آینده مشکلساز میشه و میتونه برامون دردسر درست کنه؟

رجینا رینی: لیا کوهن3، منو با این فناوری آشنا کرد. اون زمانها من و لیا روی موضوع انتشار اخبار ساختگی تحقیق میکردیم. قبلاً دربارۀ اخبار جعلی و دروغپراکنی نوشته بودم، اما اوایل سال ۲۰۱۸، قبل از اینکه بیشتر مردم راجعبه دیپفیکها بشنوند، لیا دربارۀ این پدیدۀ جدید و نوظهور بِهِم میگفت. (دربارۀ اخبار ساختگی، بیشتر بخوانید.)

بر اساس آمار و ارقامِ بهدستاومده، بیشترین نگرانیای که در استفاده از دیپفیک شاهدش هستیم، تولید هرزهنگاری یا بهتر بگم، پورن انتقامجویانه است. مردم در اینترنت چهرۀ نامزد سابقشون، کسی که دوستش ندارند و غیره رو به شخصیتهای هرزهنگاری تبدیل میکنند، تصاویر مستهجن از اونها میسازند و این کارو عمداً یا برای تفریح و خنده و یا برای ازبینبردن بقیه انجام میدن.

و بنابراین، من و لیا روی اصول اخلاقی این کار و آسیبی که به اهداف دیپفیک میزنه، شروع به کار کردیم. ما مقالهای4 دربارۀ این نگرانیهای اخلاقی داریم که بهزودی در مجلۀ اخلاق و فلسفۀ اجتماعی منتشر میشه. مقالۀ قبلی من بحث جداگونهایه که اختصاصی راجعبه مفاهیم معرفتی [دیپفیک] نوشتم.

زن بواگ: شما گفتید هدف مقالهای که قبل از فراگیری دیپفیک نوشتید، طرح نگرانیهایی بود درمورد این فناوری و کاهش سطح دانش در جوامع دموکراتیک. ما در سال ۲۰۲۰ انتخابات ریاستجمهوری ایالات متحده رو داشتیم. آیا دیپفیک نقشی در اون انتخابات داشت؟ یعنی آیا ما الآن شاهد اون نگرانیهایی هستیم که میترسیدید اتفاق بیفتن؟

رجینا رینی: خوشبختانه به نظر میرسه که دیپفیکها نقش چندانی در انتخابات ریاستجمهوری ۲۰۲۰ ایالات متحده نداشتهاند. من هیچ مورد خاصی ندیدهام که دیپفیک روی رأیِ کسی تأثیر گذاشته باشه. ولی دارم برخی از نشونههای چیزی که ازش میترسیدم رو میبینم. این نشونهها دارن به ما هشدار میدن. من چندین مناظره در توییتر دیدهام که در اون، ویدئویی واقعی و حقیقی از یه نفر پخش شده، درحالیکه داره کاری احمقانه یا توهینآمیز انجام میده یا حرفی اینچنینی میزنه، ولی مردم توی نظرات گفته بودند: «مطمئنی که این ویدئو دیپفیک نیست؟» و این نشونهایه از چیزی که میترسیدم اتفاق بیفته. این مسئله همون چیز ترسناکیه که بهنظرم بهزودی بازوی قدرت سیاستمداران میشه؛ به این صورت که با انتشار دیپفیکهای سیاسی موقع انتخابات سعی در تغییر روند طبیعی اون رو خواهند داشت، حالا چه در ایالات متحده و سال ۲۰۲۴ و چه در کشورهای دیگه قبل از اون. ولی ما الآن شاهد چیزی هستیم که من قبلاً هشدارش رو داده بودم.

زن بواگ: من، کمی بعد، به اون موضوع کاهش اعتماد به فناوری ویدئویی برمیگردم. اما ابتدا میخوام درمورد انتخابات و تولید دیپفیک بهقصد فریب افکار عمومی صحبت کنم. حالا فرض کنید که قراره ویدئویی از تبانی یکی از نامزدهای ریاستجمهوری با یه کشور دیگه برای دخالت در انتخابات آینده ببینیم. البته شاید باورش سخت باشه که این ویدئو واقعی باشه؛ چون همونطور که شما میگید، بسیاری از بازیگران سیاسی داخلی و خارجی، صرفنظر از حقیقتی که پشت این ماجرا پنهانه، انگیزههای قویای برای ساختن چنین کلیپهایی دارند. این به کنار، آیاتکنولوژی اونقدری پیشرفت کرده که بشه باهاش آدما رو فریب داد؟ و اگر نه، فکر میکنید چقدر دیگه طول میکشه تا به این حد برسه؟

رجینا رینی: بستگی داره به اینکه منظور شما از فریب چیه. این فناوری همین الانش هم اونقدری پیشرفتهست که میتونه ویدئویی درست کنه که اگر کسی بخواد واقعی یا جعلیبودنش رو متوجه بشه، باید حداقل یک یا دو روز زیر ذرهبین بررسیش کنه. همین تواناییش بین مردم بحث ایجاد میکنه. دیگه مدام باید بپرسند که آیا فلان ویدئو واقعیه یا نه. و حدس من اینه که در بیشتر موارد، این مدل ویدئوها بین مردم بهنوعی بیاعتبار میشن. بالأخره یکی پیدا میشه که یا ازطریق ابزارهای فنی یا با کشف بعضی جزییاتِ منطقی توی تولیدات دیپفیک، بفهمه که فلان فایل صوتی یا تصویری جعلیه یا نه؛ مثلاً بگه که «این عکس نباید توی پسزمینه باشه، چون اون زمان فلانچیز که ساخته نشده بوده یا وجود نداشته» یا چیزهایی شبیه به اون. مردم درنهایت این چیزها رو رد میکنند. اما سؤال اینجاست که ردکردن و بیاعتبارسازی این تولیداتِ جعلی تا کی قراره طول بکشه؟

اگه ویدئویی که بد و غیرحرفهای تدوین شده رو نگاه کنید، سریع برمیگردید و میگید که این ویدئو جعلیه. اما مشکل دیپفیک اینجاست که نمیشه به این سادگیها گفت جعلیه. یعنی تشخیص دیپفیک بهمراتب بیشتر و بیشتر طول میکشه. و این روند که باعث میشه مردم سر جعلیبودن یا نبودن ویدئوها باهم به مشکل بخورند. یعنی یه دودستگی ایجاد میشه که یه طرف میگن فلانویدئو جعلیه و یه طرف دیگه میگن نه.

و بعداً هم که معلوم میشه فلانویدئو جعلی بوده، بازهم یهسریها بهخاطر اینکه اونقدر در جناح حزبی خودشون غرق شدهاند، نمیتونن قبول کنند که واقعاً دیپفیک بوده؛ حتی اگه کلی شاهد و مدرک براشون بیاری که فلانویدئو جعلیه. حالا دیگه مسئله این نیست که چقدر طول میکشه تا این ویدئوها بین مردم بیاعتبار بشن، الآن مهم اینه بدونیم تا وقتی که معتبرند، چه مشکلات و مسائلی برای ما به وجود خواهند آورد؟

زن بواگ: شما درمورد استفاده از دیپفیک برای بیاعتبارکردن افراد هم مطلب نوشتهاید. همونطور که خودتون میگید، لزوماً نیازی نیست که همه باورش کنند تا تأثیر خودش رو داشته باشه. مثالی هم که زدید از اقدامی بود برای بیاعتبارکردن فرماندار چچن. بله، انگیزۀ اونا از این کار، فریبدادن کسی نبود، بلکه بدنامکردن استاندار بود. مشخصه که این امر بهنوعی برای افراد برجسته ایجاد خطر میکنه. اما همونطور که شما میگید، اگر این فناوری به گوشیهای هوشمند مردم برسه، اونوقت همه رو تحتتأثیر قرار میده. هرکسی که بهنوعی دشمن داشته باشه، میتونن علیهش از این فناوری دیپفیک استفاده کنند. وقتی صحبت از بیاعتبارشدن آدما میشه، آیا این رو بیشتر خطری برای افراد برجسته میبینید یا افراد عادی؟

رجینا رینی: شاید عجیب به نظر بیاد، ولی من فکر میکنم خطر بیاعتبارشدن در درازمدت بیشتر متوجه مردم عادیه. چون هم منابع کمتری در اختیارشونه، هم اینکه اگر ویدئویی جعلی برای آدم سرشناسی درست بشه، بهخاطر حزب و طرفداراشون و پیگیریهایی که میکنند، اون ویدئو رو از بین میبرند.

ازنظر آشوب اجتماعیِ محض، انتشار یه ویدئوی جعلی از دونالد ترامپ، یا جو بایدن، یا بوریس جانسون، یا هرکسِ دیگهای، باعث درگیری شدید خواهد شد، اما خوشبختانه این درگیری درنهایت ازطریق قانون حل میشه. ولی اگه یه ویدئوی جعلی از شما یا پسرعموتون منتشر بشه، شاید هیچکس توی حلقۀ اجتماعیتون نباشه که بتونه اون ویدئو رو کلاً پاک کنه، حتی اگه کلی وقت داشته باشه.

پس شاید ابتدا موردی از پروندههای پرمخاطب مربوط به آدمای مشهود یا یه سیاستمداری رو ببینیم، اما فکر میکنم در درازمدت، این کار عواقب واقعاً ترسناکی برای مردم عادی داره.

زن بواگ: دررابطهبا افراد مشهور و سیاستمداران، شما گفتید که اونها منابع لازم رو دارند، یا حداقل اگر در این مورد بحثی صورت بگیره، عموم مردم سعی میکنند که دیپفیک رو از بین ببرند. اما شما به نکتۀ بسیار خوبی اشاره کردید: اینکه ویدئوی شفافسازی هرگز به اندازۀ ویدئوی اصلی پخش نمیشه. حالا که استفاده از دیپفیک رو به افزایشه، چطوری میتونیم به ویدئوهایی که میبینیم اعتماد کنیم؟

رجینا رینی: از بزرگترین نگرانیهای من که نکتۀ کلیدی مقالهام هم هست، اینه که فکر میکنم ویدئوها نقشی نادیدهگرفتهشده در عملکرد معرفتی و عمومیِ ما داشتهاند که من بهشون میگم «پشتیبان معرفتی». بسیاری از چیزهایی که دربارۀ جهان یاد میگیریم، از حرفهاییه که مردم به همدیگه میزنند؛ چیزی که فیلسوفان بهش میگن «گواهی». من به شما میگم فلاناتفاق افتاده، شما هم به من میگی فلاناتفاق افتاده. اینکه باور کنیم فلاناتفاق واقعاً افتاده یا نه، به این بستگی داره که چقدر به گویندهاش اعتماد داریم.

و من فکر میکنم ویدئوها و صداها غیرمستقیم تأثیر میذارن تا ما کمی بیشتر حواسمون به گواهیای که میدیم باشه. چون میدونیم احتمالش هست ویدئو یا صوتی پیدا بشه که نشون بده ما قبلاً جایی اغراق کردهایم، یا دروغ گفتهایم، یا اشتباه به یاد آوردهایم. و اینها همه دلیل درستیاند برای اینکه ما فقط کمی مراقب باشیم، اغراق نکنیم و وقتی درمورد اونچه اتفاق افتاده مطمئن نیستیم، صادقانه بگیم. و اینجور چیزها.

و بنابراین، نگرانی من از اینه که دیگه نتونیم به ویدئوها و صداها اطمینان کنیم، چون تا حالا کلی دیپفیک دیدهایم که خیلیهاش هم شکست خورده و مردوده. و با گذشت زمان نمیتونیم برای درستوغلطبودن یه موضوع به ویدئوها و صداها استناد کنیم. و بنابراین، اون اعتمادی هم که برای گفتن و شنیدن حقیقت به همدیگه داشتیم رو کمکم از دست خواهیم داد.

زن بواگ: و شما از این بهعنوان «نقش تنظیمی و منفعلانۀ ویدئوها و صداها» اسم میبرید، که مهمتر از نقش «اصلاح حاده». همونطور که میدونید، جرمی بنتام، سراسربین رو اختراع کرد؛ سراسربین، بُرجیه که وسط زندانها میسازند. اون زندانه یه ساختار دایرهای داشت. همه فکر میکردند که تحتنظرند، بنابراین رفتارشون بر این اساس اصلاح شد. حالا سؤالم اینه که آیا ویدئوها هم (حداقل تا قبل از ظهور دیپفیک) اثری مشابه این سراسربینها داشتهاند یا نه؟ یعنی اینطوری که احساس کنیم مدام تحت نظریم و بنابراین باید مراقب رفتارمون باشیم.

رجینا رینی: فکر میکنم این حرف میتونه درمورد فضاهای عمومی صادق باشه، بهخصوص در کشورهایی مثل انگلستان یا چین که همهجاش دوربینهای مداربسته کار گذاشتهاند. فکر میکنم حتی در فضاهای نسبتاً خصوصی هم روزبهروز بیشتر جا پیدا میکنه، چون مردم تلفنهای همراهشون رو همهجا با خودشون میبرند، و هرگز نمیفهمید کسی که دقیقاً کنارتون وایساده، کِی تلفنش رو برداشته و کِی شروع کرده به فیلمبرداری از خودش.

بههرحال فکر میکنم روزبهروز بیشتر برامون عادی میشه که آدمهای دوربینبهدست رو ببینیم. نمیدونم بودنمون توی این لحظة تاریخی، یعنی دورهای که همه فیلم و صدا ضبط میکنند، غمانگیزه یا عجیب. این ضبطکردنها هم مثل همون ایدۀ سراسربینِ بنتامه، ولی خطر دیپفیک جلوش رو میگیره. اینطوری که باعث میشه این ضبطشدنها نتونن انتخابهامون رو تنظیم کنند. احتمالاً یکیدو دهۀ دیگه این دو لحظۀ تاریخی بههم برخورد کنند و ما هم باید باهاشون کنار بیایم و زندگیمون رو ادامه بدیم.

زن بواگ: شما میگید همین که احتمال داشت کسی فیلم و صدای ما رو ضبط کنه، دلیل محکمی بود برای اینکه همیشه حقیقت رو بگیم. اما حالا که پای دیپفیک وسطه، دیگه چطوری میشه به فیلم و صداهای ضبطشده اعتماد کرد؟

رجینا رینی: میتونیم به این موضوع ازمنظر پیامدهای آشکار و پنهانش نگاه کنیم. یکی از پیامدهای آشکارش همون چیزیه که دانیل سیترون و بابی چسنی، نظریهپردازان حقوقی، بهش میگن «سود سهام دروغگو». به این معنا که چهرههای سیاسی میتونن ازاینبهبعد، به حرفهایی که در انظار عموم میزنن اهمیتی ندن. چون همیشه و در هر حالتی میتونن ادعا کنند صوت و تصویری که ازشون پخش شده، فقط یه دیپفیک بوده. اگر این حرفشون همیشه خریدار داشته باشه، خیلی راحت با گفتنِ «این ویدئو/صوت، دیپفیکه. مخالفان سیاسیم ساختنش» میتونن خیلی کمتر از اینها به حرفهایی که میزنن دقت کنند. میتونم تصور کنم که این وضعیت چقدر بدتر هم میشه. مثلاً فرض کنید یه سیاستمدار، آشکارا در حضور جمعیتی ملیگرا از نژادپرستی دفاع میکنه و اون رو ارزش جلوه میده، بهقصد اینکه اون جمعیت ملیگرا رو برای اعتراضات خیابونی بسیج کنه، و بعداً هم به مخاطبان عمومی و بینالمللی میگه: «من هرگز این کار رو نکردم. این فیلمی که از من پخش شده و نشون میده دارم این حرفها رو میزنم، دیپفیکه.» چهرههای سرشناس میتونن با دیپفیک، مخاطب رو بهطور همزمان در دو سطح فریب بدن. و ازاونجایی که شواهد خارجی عموماً نادیده گرفته میشه، دیگه کسی بهدنبال راستیآزمایی ویدئوهایی که من و شما ضبط کردهایم، نخواهد بود.

بهنظرم اینها تهدیدهای آشکاری علیه حقیقتگوییاند. پیامدهای پنهان این قضیه مربوط به بقیۀ ماست، ماهایی که مثل سیاستمداران، انگیزههای پنهانی نداریم، اما باوجوداین، فکر میکنم انتخابهایی که انجام میدیم، روزبهروز بیشتر تنظیم میشه؛ بهخاطر اینکه احتمال میدیم کسی داره ازمون فیلم میگیره یا صدامون رو ضبط میکنه. یا اصلاً فیلمبرداری از ما هم نه؛ بلکه از اتفاقی که پنجشنبة گذشته یه جایی توی خیابون افتاده و ما هم شاهدش بودیم. حتی اگه لحظهای که داشتم راجع به اون اتفاق بهتون میگفتم، کسی ازم فیلم نمیگرفت، شاید یه نفر داشته از اتفاقات پنجشنبة گذشته از یه جایی توی خیابون فیلم میگرفته و ویدئوش بعداً پخش بشه.

بهمحض اینکه متوجه بشیم ویدئویی که اتفاقات پنجشنبۀ گذشته ضبط شده، میتونه جعلی باشه، دیگه نیازی نیست خیلی جدی بگیریمش. حرفم این نیست که همۀ ما بشیم مثل این سیاستمدارای ماکیاولیستی که مدام دروغ میگن؛ فقط میخوام بگم که ما تمایلات طبیعی انسان نسبت به اغراقکردن رو دستکم میگیریم و حقیقت رو طوری جلوه میدیم که کمی به نفع خودمونم باشه. نمونهاش هم همین کارهاییه که مردم انجام میدن. مسئله اینه که با این کارها یکی از بازدارندههایی که نمیذاشته فلانرفتار رو انجام بدیم، کمکم از بین میره.

زن بواگ: این یه لحظۀ کاملاً تحولآفرینی برای حقیقت محسوب میشه. چون همونطور که توی مقالۀ خودتون گفتید، در زندگی همۀ کسانی که الآن زندهاند، موارد ضبطشده همواره وجود داشته. و طی چند دهۀ اخیر بیشتر هم شده، چون از دوربینهای مداربستۀ بیشتری استفاده میشه؛ و خُب، اکثر آدمها گوشی هوشمند دارند. شواهد ادراکی بسیار بیشتری نیز موجوده و میتونه چیزهایی که ادعا میکنیم اتفاق افتاده رو تأیید یا رد کنه. در مواجهه با اقدامات دادگاهی، مسائل حقوقی و فعالیتهای جنایی، شواهد ویدئویی اغلب علیه افراد در دادگاه استفاده میشه. چه اتفاقی برای این مدل شواهد میافته؟ آیا شواهد ویدئویی دیگه به اندازۀ قبل اعتبار نخواهند داشت؟

رجینا رینی: این واقعاً سخت خواهد شد؛ تحلیلگران کامپیوتر پزشکی قانونی و نظریهپردازان حقوقی باید روی استانداردهای جدیدی برای شواهد کار کنند. موضوعی که باید بهش فکر کرد، و خبر دارم که الآن یه عده دارن روش میکنند، به ایدة زنجیرة نگهبانی دیجیتال مربوط میشه؛ یعنی برای اینکه یه نوار ویدئویی، شاهدی قوی در دادگاه محسوب بشه، باید مستندات دیگهای از اون فایل دیجیتالی موجود باشه، مثلاً نحوۀ ضبطشدنش، زمانِ ضبطشدنش و اینکه چه کسانی تا زمان دادگاه بهش دسترسی داشتهاند. اساساً باید نسبتبه منبع فایلهای ضبطشده، دقت بسیار بیشتری داشت.

و این یعنی بسیاری از انواع فایلهای ضبطی که برامون معمولی و عادیه، این زنجیرۀ نگهبانی رو ندارند. اونها همون دلیلی که نیازه تا بتونیم بهشون اعتماد کنیم رو بهمون نمیدن. و این ناراحتکنندهست، چون مثلاً برخی از بهترین نمونههایی که داریم، به خشونت پلیس مربوط میشه. تعداد زیادی فایل ضبطشده از بدرفتاری پلیس با افراد رنگینپوست موجوده. بهخصوص توی ایالات متحده، اون ویدئوها نقش بزرگی در ایجاد باور عمومی در این راستا ایفا کردهاند.

و نگرانیمون از اینه که در آینده، وقتی شهروندان عادی این موارد رو ضبط میکنند، نتونند همون سطح بالای اثبات، یعنی اون زنجیرۀ نگهبانی دیجیتال رو با تلفن همراه خودشون نشون بدن. و بنابراین، بهلطفِ(!) دیپفیک نتونن با استانداردهایی که در آینده برای شواهد در نظر میگیرند، پابهپا پیش برن و چیزی رو اثبات کنند.

با گسترش دیپفیک، اون اعتمادی هم که برای گفتن و شنیدن حقیقت به همدیگه داشتیم رو کمکم از دست خواهیم داد. حتی کمکم دیگه نمیشه به ویدئو هم اعتماد کرد.

زن بواگ: بله، در گذشته فایلهای ضبطی، شواهد تصدیقی را تأیید یا تصحیح میکردند. آیا این یعنی ممکنه که فایلهای ضبطی، شواهدی ناچیز بشن؟

رجینا رینی: درصد بالایی احتمال میدم فایلهای ضبطی نقش اجتماعی مشابهی رو ایفا کنند. اگر به کسی که کار ضبط رو انجام داده اعتماد داشته باشید، میتونید به چیزی که توی اون ویدئو میبینید اعتماد کنید، وگرنه اعتماد نکنید. اگر نمیدونید چهکسی کار ضبط رو انجام داده، یا اگر بهنظرتون آدم قابلاعتمادی نیست، احتمالاً باید فایلهای ضبطی رو نادیده بگیرید. شاید هنوز نه، اما با کمک تکنولوژی به اونجاها هم خواهیم رسید. ما به نقطهای میرسیم که باید فایلهای ضبطی رو بهکل نادیده بگیریم، مگه اینکه به اون شخص اعتماد داشته باشیم.

خواهید دید که چقدر این مسئله مهمه، چون ما هنوز کاملاً به اون نقطه نرسیدهایم. الان شما نمیدونید ویدئوهایی رو که توی اینترنت میبینید، کی ساخته یا چطوری پخش شده. و پیشفرض، واقعیبودن اونها رو قبول میکنید. در بهترین حالت، نسبت به ویدئویی که میبینید کمی شک دارید و با تفکر انتقادی نگاهش میکنید، اما به ذهنتون نمیرسه که شاید کاملاً با رایانه ساخته شده باشه. اما در آینده، باید جعلیبودن ویدئو رو مفروض بگیرید، یا حداقل بهش شک کنید مگه اینکه زنجیرۀ نگهبانیش رو بدونید.

زن بواگ: قبل از اینکه فایلهای ویدئویی در جامعه بسیار رشد کنه، عکسها بهعنوان پشتوانۀ معرفتی برای شواهد تصدیقی عمل میکردند. اما بعداً فیلمهای ضبطشده جایگزین شدند. الآن دیگه چند دهه است که میشه با نرمافزارهای ویرایش عکس مثل فتوشاپ، توی عکسها دست برد و این کار لزوماً تأثیر مخربی بر اعتماد ما به عکسها نداشته. به نظر میرسه که ما میتونیم یه عکس جعلی رو از یه عکس واقعی تشخیص بدیم. بازم همونطور که شما میگید، ما قضاوت خودمون رو بر اساس منابع و احتمال صحت اون فایل استوار میکنیم. فرق دیپفیک با نرمافزارهای ویرایش عکس در تهدیدی که میتونن برامون داشته باشه چیه؟

رجینا رینی: این خیلی سؤال خوبیه، و درسته که عکسها اصلیترین چیز در اجرای این نوع نقش پشتیبان فناوری بودند، بهخصوص قبل از اینکه نوار ویدئویی ارزون بشه. و بله، خوبه که بپرسیم، تفاوتشون چیه؟

فکر کنم یکی از تفاوتهای مهمشون این باشه که وقتی جعل تصاویر، هم ارزون و هم آسون شد، مثل انتشار فتوشاپ تو دهة ۱۹۹۰، نوارهای ویدئویی نقش پشتیبان معرفتی رو به عهده گرفتند. ما در دنیایی نبودهایم که بشه عکسها رو ارزون و راحت جعل کرد، بدون اینکه چیز دیگهای نباشه که همون نقش رو ایفا کنه.

علاوهبر این، بهدلیل اینکه نوار ویدئویی ازنظر زمانی طولانیه، نسبت به عکس معتبرتره. همة ما میدونیم که اگه یه عکس ثابت بگیرید، درست قابش کنید، دقیقاً در زاویة مناسب بایستید، نور رو هم دقیقاً از راه درست دریافت کنید، میتونید یه صحنه رو در همون یک ثانیه بهشکلی نادرست نمایش بدید، حتی بدون هیچگونه ویرایشی. شما میتونید وقتی یه نفر خمیازه میکشه، از حالت چهرهاش عکس بگیرید، و میتونید کاری کنید طوری به نظر برسه که انگار داره فریاد میزنه. همهمون اینو میدونیم.

و بخشی از چیزی که همیشه در جریان بوده اینه که اگه صحت یه تصویر ثابت شدیداً محل بحث باشه، مردم میپرسند: «خب، آیا ویدئویی هم هست؟ آیا میتونیم دقیقاً قبل و بعد این صحنه رو ببینیم؟ آیا میتونیم ۱۰ ثانیه قبل و بعد این صحنه رو داشته باشیم؟ آیا این تصویرِ ثابت نشوندهندۀ چیزیه که داره اتفاق میافته؟» و مشکل الآن اینجاست که کمکم دیگه نمیشه به ویدئو هم اعتماد کرد، جایی که این انبساط زمانی دیگه تضمین قویتری در صحتسنجی نیست.

زن بواگ: همین الان یه چیزی به فکرم رسید: اگه نتونیم به فیلمهای ضبطشده بهعنوان پشتوانۀ معرفتی برای شواهد تصدیقی اعتماد کنیم، آیا در گام بعدی این ترس وجود داره که به جایی برسیم که دولتها بگن: «خب، به همین دلیله که ما باید همهجا دوربین مداربسته کار بذاریم. ما باید همهچیزو در همهجا و همیشه ضبط کنیم که بعداً بهعنوان مدرک نهایی استفاده بشه.» این میتونه بهونهای باشه برای دولتها، نهادها یا سازمانها تا دوربین مداربسته رو همهجا کار بذارند. همهجا! بنابراین ما مدام زیر ذرهبینیم. آیا این ترس درستیه؟

رجینا رینی: برخی از دولتها همین الآن هم دارند این کارو انجام میدن. قبلتر اشاره کردم که بریتانیا و چین هر دو تعداد زیادی دوربین مداربسته کار گذاشتهاند، تقریباً به ازای هر نفر یکی. و این دولتها هر دوشون بسیار متفاوتاند، جامعهشون هم همینطور؛ اما در حال حاضر ازنظر تعداد دوربینهای مداربسته در جهان اولاند. قبل از دیپفیک هم وضع همینطور بود. باتوجهبه این نکته، حق با شماست که برخی جوامع همین روند رو پیش بگیرند.

دیپفیکها اساساً نوع مشکلاتی که سر راهِ حقیقته رو تغییر نمیدن، چون همین الانش هم حقیقت با مشکلات زیادی مواجهه.

زن بواگ: میشه یکی دیگه از ترسهامو هم بگم؟ چی میشه اگه دولتها دوربینهای مداربسته رو نصب کنند و بگن، «خب، ما فایلهای ضبطی رو داریم. و این تنها چیزیه که میتونیم بهش اعتماد کنیم. هرچیزی که شماها ضبط میکنید، شواهد تصدیقیه و هرچیزی که ما ضبط میکنیم مدرک.» بدیهیه که وقتی تنها شهادت ویدئویی دولت ملاکه، پای خیلی از مسائل مختلف وسط میآد؛ چون مشخصه که میشه اون ویدئوها رو هم دستکاری کرد.

رجینا رینی: بله موافقم. احتمال ترسناکیه. انگار با یه دیکتاتوری و خودکامگی همراهه. چون اگه نسبت به تمام شواهد ویدئویی یا صوتی، بهجز اونهایی که منحصراً برای دولت «قابلاعتماده»، شک و تردید وجود داشته باشه، مسلماً کسانی که میخوان کارهای نادرست انجام بدن، وسوسه میشن که منبع انحصاری فایلهای ضبطی مورداعتماد رو تحتکنترل خودشون بیارند. و بنابراین، بله، این کار بسیار ترسناکه.

مشکل اینه که ما نمیتونیم با شواهد قانونی جلوشو بگیریم. اگه بخوایم از فایلهای ضبطی بهعنوان شواهد قانونی بهره ببریم، باید بتونیم منابع مورداعتماد رو شناسایی کنیم. و استراتژیمون باید این باشه که راهی پیدا کنیم که این موضوع فقط مربوط به دولت یا یه شرکتها نباشه. ما قطعاً نمیپذیریم که اینطوری بشه. ما به چیزی گستردهتر و غیرمتمرکز نیاز داریم.

مثلاً بعضیها میگن از فناوری بلاکچین استفاده کنیم که ببینیم آیا فایلهایی که ضبط شدهاند، قابلاعتمادند یا خیر. من اخیراً این مورد رو بررسی نکردهام، اما بهنظرم وقتی متوجه بشیم که استفاده از بلاکچین در درازمدت مقرونبهصرفه نیست، ازش گذر خواهیم کرد. تصور کنید که همۀ ویدئوهای ضبطشده در هر نقطه از جهان رو در یک بلاکچین یا هرجای دیگه بگنجونیم! شاید هم شدنی باشه؛ من که متخصص کامپیوتر نیستم، اما بهنظر انتظار زیادی میآد که بخوایم این کارو کنیم.

زن بواگ: طولی نمیکشه که میبینیم هرجا و هرلحظه دارن ازمون فیلم میگیرند و دولت همهچیزو کنترل میکنه. آیا احتمال داره که «حقیقت» در کوتاهمدت، قربانی فناوری دیپفیک بشه؟

رجینا رینی: شاید تعجبآور باشه اما دیدگاه من اینه: دیپفیکها اساساً نوع مشکلاتی که سر راهِ حقیقته رو تغییر نمیدن، چون همین الآنش هم حقیقت با مشکلات زیادی مواجهه. بهنظرم دیپفیکها وضعیت رو پیچیدهتر میکنن و به تنشهای سیاسی بیشتر پر و بال میدن، اما ظاهراً خودِ حقیقت برای مدت طولانی، حداقل یه دهه، بیشتر موردحمله قرار گرفته. سایر اشکال فناوری دیجیتال هم همواره تلاش میکردهاند که از بین ببرنش.

چیزی که الآن بیشتر از همه ازش میترسم، و هنوزم واقعاً اتفاق نیفتاده، هوش مصنوعی مدل زبان طبیعیه، مثل GPT-3 که از یادگیری ماشینی برای ایجاد خودکار متون انگلیسی استفاده میکنه. بهنوعی، شبیه دیپفیکِ مقالات روزنامه یا مدخلهای دایرةالمعارفه. این هوش مصنوعی میتونه متون بسیار دقیقی تولید کنه که آدمیزاد نتونه تشخیص بده انساننویسه یا کامپیوتری!

میشه باهاش نوعی اخبار جعلی و هرزنامه تولید کرد، در حدی که تمام کانالهای ارتباطی ما رو با مقادیر زیادی از اخبار جعلی پُر کنه. واضحه که میتونیم جعلیبودن بسیاری از مطالبی که تولید میکنه رو بفهمیم، ولی ما اونقدر با تولیداتش بمبارون میشیم که حتی پیداکردن یه خبر واقعی سختتر، سختتر و سختتر میشه. و خب این چیزیه که واقعاً ازش میترسم. بنابراین، احساس میکنم نیازی نیست اونقدرها هم نگران دیپفیک باشیم، ظاهراً چیزهای بدتر از دیپفیک هم هست. درهرحال، همۀ اینها مجموعهای از چیزهای ترسناکاند که هدفشون جلوگیری از کشفِ حقیقته.